Diversas películas nos han dado una angustia histórica sobre el poder del hombre a crear algo que rompa las leyes de la naturaleza y lo iguale como un padre creador de la existencia a algo más poderoso que lo envuelva y lo arrastre a mundos distópicos, que lo manipule a conveniencia de unos pocos o que le haga vivir en lo ilusorio de un mundo confortable, a su medida.

En este contexto, el Observatorio Venezolano de Fake News (OVFN) indica que desde el monstruo Frankenstein, de Mary Shelly, pasando por la saga de cintas y series de Terminator, Matriz y la más onírica, Abre los Ojos -del español Alejandro Amenábar- hemos sido sembrados del miedo a ser víctimas de la reversión de nuestras creaciones en seres inteligentes, o a estar rodeados en un mundo-sistema creado por máquinas para control de nuestro comportamiento, energía y producción.

En un artículo escrito por el periodista León Hernández y Rodolfo Rico indican que «cuando se avecinaba el año 2000, se corría pensando en el acabose de mega volúmenes de data, por la idea de que el cambio de año haría irreconocible la capacidad de almacenamiento. Poco a poco, las fobias también han dejado aprendizajes y en medio de la tecnología, los extremos humanos siguen siendo los eslabones principales de la cadena».

«El tema es que no todo lo relativo a la Inteligencia Artificial es desechable en el multiverso contemporáneo actual, donde las potenciales ideas en el campo académico, solo por citar un caso, nos abrumen de posibles plagios, tareas realizadas por encargo, o incluso encubrimientos de actos de corruptela. Recordemos, antes de entrar en materia de desinformación, que la inteligencia artificial es una herramienta, como toda, depende de la intencionalidad de los usuarios su papel benefactor o destructor», apuntan en el texto.

La desinformación como objetivo posible de la IA

Aún no sabemos si los androides sueñan con ovejas eléctricas, cómo se preguntaba Phillip K. Dick en su novela. Lo que sí sabemos es que cada vez es más difícil para los humanos distinguir la realidad y además más barato crear realidades plausibles, que se parecen a lo real, que apenas pueden distinguirse o que podrían no hacerlo en absoluto. Y todo eso es una mala noticia para un mundo en el que distintos tipos de intereses promueven la desinformación, agregan.

Con media docena de palabras se puede crear una imagen o un video que sólo por errores de entrenamiento (dientes y dedos supernumerarios en el caso de las fotos) pueden distinguirse. También es posible desarrollar software apoyado por inteligencia artificial, pero que una vez más puede generar soluciones tanto reales como plausibles, aunque en el conocido foro de desarrolladores Stack Over Flow prohibieron su uso, por sus errores en la soluciones ¿Si charlas con alguien y eres incapaz de distinguir si es humano realmente lo es? El conocido chat gpt-3 logra ser sumamente coherente en sus respuestas, sabe sintetizar a partir de información disponible y también inventar. Y si la conversación se alarga puede salir a flote alguna personalidad cercana a tu distopía de dominación de máquinas favorita. Por supuesto, toda esta tecnología está en período de prueba, pero sigue siendo muy útil sobre todo porque lo que basta para que algo parezca real se une al sesgo de confirmación que puede tener cada quien, lo que sin duda ayuda a la difusión de desinformación.

Hay algo que es preciso advertir, todos los riesgos y errores de estas inteligencias artificiales eran conocidos y sabidos desde al menos 2017, cuando la responsable de ética de Google fue expulsada por la empresa por compartir un documento en el que sintetizaba la situación con numerosas referencias a otros investigadores.

¿Qué ha pasado ahora?

¿Ha escuchado la expresión a cada cochino le llega su sábado? Pues bueno a cada tecnología le llega su momentum. Y en 2022 fue en definitiva la de las inteligencias artificiales conversacionales, fue el año en que un ingeniero de Google sostuvo que la AI conversacional de la empresa tenía conciencia y sentimientos. El año en que Meta regaló su desarrollo tipo GPT3 para la investigación con todos los detalles sobre cómo fue entrenado y hasta usó la misma cantidad de parámetros que Open AI (175 millones). Fue el año en que la facilidad de integración de ChatGPT3 resultó tan simple de implementar que distintas empresas crearon una simple caja de texto que podía responder en múltiples situaciones. Usted pregunte que la IA le responde como si fuera su mejor amigo.

El uso de internet centrado en los buscadores hace que la mayor parte de los usuarios simplemente navegue a partir de los resultados de las búsquedas y de las respuestas generadas de internet. Google tiene años además sugiriendo resúmenes de respuestas que hacen que la gente no tenga la necesidad de ir hasta la web.

Algunos han llamado “efecto burbuja” al resultado de controlarse, de alguna manera por las predilecciones de los propios usuarios, el término de una búsqueda. De las creencias preexistentes, y de los patrones que como individuos vamos dando a nuestro consumo web, los resultados. ¿Podríamos sentirnos más cómodos con lo que no estamos dispuestos a leer, consumir, escuchar?, no. De allí que con Inteligencia Artificial se nos “ayude” a encontrar de manera más directa y expedita lo que queremos. ¿Capacidad de adaptación a nuestras preferencias? Todas. Lo malo es que nos distancia de lo distinto, nos encadena a la misma familia de preferencias, con menos satisfacción por el otro y más refuerzo al individuo.

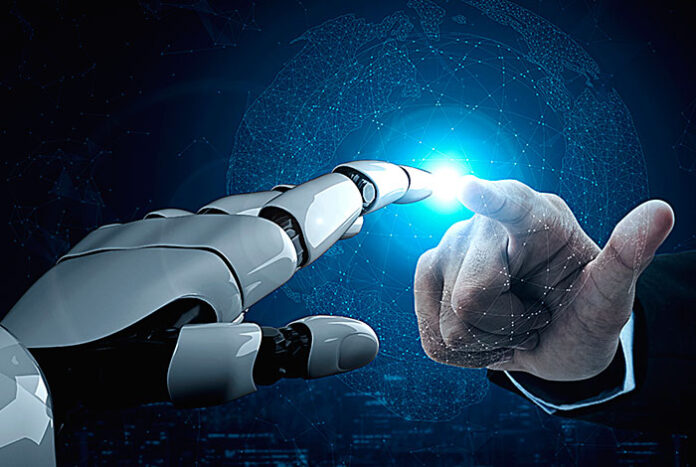

Los programadores han logrado colocar caras y voz a texto elaborado por algunos. Con rostros donados o comprados a ciertas compañías se ha logrado fingir reportajes sobre situaciones, a partir de casos como el desarrollo de la reciente Serie del Caribe. El fingimiento del reportaje incluye compañía de noticias ficticias, falsos indicadores de éxito de gestión pública, y la aparente y desinteresada mirada de un narrador anglosajón, sobre la realidad venezolana. El maquillaje es tan creíble, que desmentirlo amerita el uso muy sofisticado de otras aplicaciones. La sustitución de la realidad es lo que se pretendía. ¿Cómo haremos para superar esas críticas imitaciones y alteraciones? ¿Cuál será la capacidad de distinguir? Pero más allá, ¿estaremos ante la posibilidad de también querer consumir realidades alternas como las que se consiguen con la Inteligencia Artificial? ¿Se puede construir la reputación de un país con Inteligencia Artificial? Este fue el desmentido que publicó el Observatorio Venezolano de Fake News sobre este caso.

¿Se puede, entonces, declarar una guerra a través de mecanismos de manipulación propios del uso antiético de la Inteligencia Artificial?

«Los juegos de guerra de la desinformación alcanzan un nuevo nivel con estas herramientas generadoras de imágenes, voces y conversaciones», concluyen.